Pourquoi l’IA s’impose dans le développement web

L’intelligence artificielle transforme profondément le paysage du développement web. Autrefois réservée à des usages exploratoires ou académiques, l’IA générative est aujourd’hui un véritable outil de productivité intégré dans le quotidien de nombreux développeurs, chefs de projet et CTO. Elle ne remplace pas encore les humains, mais elle redéfinit la manière dont les projets numériques sont conçus, structurés et produits.

Des gains de productivité significatifs

En automatisant des tâches chronophages – comme la génération de code répétitif, la documentation technique, la création de tests unitaires ou encore la correction d’erreurs – l’IA permet d’accélérer les cycles de développement. Un développeur expérimenté peut ainsi déléguer certaines tâches secondaires à une IA, pour se concentrer sur l’architecture, la qualité ou la sécurité du produit.

Mais ces gains ne se limitent pas à la vitesse. L’IA facilite également le passage à l’échelle, en proposant des solutions cohérentes et réutilisables pour des projets complexes. Cela en fait un atout précieux pour les entreprises cherchant à réduire le time-to-market sans sacrifier la qualité.

Une accessibilité renforcée pour les non-tech

L’un des impacts majeurs de l’IA dans le développement est de réduire la barrière d’entrée. Des profils non techniques peuvent désormais prototyper des interfaces, générer du code ou comprendre des architectures grâce à des interfaces conversationnelles.

Cela ouvre des perspectives intéressantes pour les petites structures ou les entrepreneurs qui ne disposent pas d’équipes techniques en interne. Toutefois, cette démocratisation cache aussi des pièges, que nous explorerons plus loin dans l’article.

Une évolution rapide des outils disponibles

Entre les copilotes de code, les assistants de planification de projet, les outils de revue automatisée, et les plateformes d’orchestration de prompts, l’écosystème IA dédié au développement web est en constante expansion. De nouveaux acteurs apparaissent chaque mois, avec des solutions de plus en plus spécialisées : frontend, backend, CI/CD, cybersécurité…

Cela pose une question essentielle pour les entreprises : comment choisir les bons outils, sans sacrifier la pérennité, la qualité ni la sécurité du produit ? Une direction technique éclairée reste ici indispensable pour faire les bons arbitrages.

Développement assisté par IA : de quoi parle-t-on vraiment ?

L’expression « développement assisté par IA » recouvre un éventail d’usages très large, souvent confondu avec de simples générateurs de code. Pourtant, cette approche va bien au-delà d’une production automatisée : elle redéfinit les rôles, les flux de travail et la collaboration entre les humains et les machines.

Une assistance, pas une automatisation totale

Le développement assisté par IA consiste à utiliser l’intelligence artificielle comme copilote dans les différentes étapes du cycle de développement. L’IA ne remplace pas le développeur, elle suggère, accélère, corrige, documente, mais elle ne prend pas les décisions critiques. Ce point est fondamental : la responsabilité finale du code, de sa cohérence et de sa sécurité, reste humaine.

Les principaux domaines d’intervention de l’IA sont :

- Génération de code à partir de descriptions textuelles.

- Traduction entre langages ou entre frameworks.

- Détection d’erreurs et propositions de correctifs.

- Création de tests (unitaires, d’intégration…).

- Documentation technique automatisée.

- Aide à la compréhension de code existant ou obsolète.

Des outils de plus en plus structurés

Si les premiers outils étaient limités à des suggestions ponctuelles dans les IDE, l’écosystème actuel propose des solutions beaucoup plus riches :

- Copilotes de développement (GitHub Copilot, CodeWhisperer…) intégrés aux éditeurs de code.

- Assistants contextuels intégrés aux plateformes de CI/CD ou de gestion de tickets.

- Interfaces conversationnelles capables de lire et modifier plusieurs fichiers à la fois.

- Agents spécialisés pour la gestion des environnements, des bases de données ou de la sécurité.

Cette montée en puissance technologique pousse à une structuration nouvelle des pratiques de développement, où la qualité du prompt et la clarté de la demande deviennent aussi importantes que la maîtrise du langage utilisé.

Ce que l’IA ne fait pas (encore)

Il est important de rester lucide : l’IA ne comprend pas le produit final dans sa globalité. Elle n’a ni vision métier, ni mémoire de projet, ni connaissance des objectifs stratégiques. Elle peut générer du code « qui fonctionne », mais sans garantie de robustesse, de maintenabilité ou d’alignement avec les besoins.

D’où l’importance d’un pilotage rigoureux : un développement assisté par IA efficace repose sur la capacité à poser les bonnes contraintes, à structurer les demandes, et à revoir chaque proposition avec un œil critique.

Vibe Coding vs Développement assisté par IA

Avec l’essor des outils d’IA générative, une pratique a émergé sur les réseaux et dans certaines startups : le « Vibe Coding ». Derrière ce terme séduisant se cache une réalité beaucoup plus problématique, surtout lorsqu’il est confondu avec une approche professionnelle du développement assisté par IA.

Le Vibe Coding : coder au feeling

Le « Vibe Coding » désigne une approche où l’on enchaîne des prompts à l’IA sans réelle structure ni compréhension technique approfondie. L’utilisateur se laisse porter par les suggestions de l’IA, sans toujours maîtriser :

- La logique métier de l’application,

- Les frameworks ou langages utilisés,

- Les conventions de codage ou d’architecture,

- Les bonnes pratiques de sécurité, performance, scalabilité.

Ce type d’approche peut donner l’illusion de productivité, notamment lors de la création de proofs of concept (POC). Il est utile pour explorer une idée rapidement, tester une hypothèse ou prototyper une interface.

Mais cette pratique atteint vite ses limites, dès qu’il faut construire un Minimum Viable Product (MVP) fiable, maintenable et sécurisé.

Développement assisté par IA : structure, maîtrise et vision

À l’inverse, un développement assisté par IA bien mené repose sur une compréhension claire des objectifs techniques et fonctionnels. L’IA y joue un rôle d’accélérateur, mais dans un cadre :

- Les choix d’architecture sont décidés en amont.

- Les prompts sont structurés, précis, versionnés.

- Chaque sortie est revue, testée, validée.

- Une cohérence globale est maintenue tout au long du projet.

L’écart entre Vibe Coding et développement assisté peut se résumer ainsi :

| Critère | Vibe Coding | Développement assisté par IA |

|---|---|---|

| Objectif principal | Explorer, improviser | Construire, structurer |

| Connaissance technique | Faible ou absente | Maîtrise des technologies utilisées |

| Utilisation de l’IA | Génération brute | Collaboration contrôlée |

| Résultat attendu | POC, démo, idée | MVP, produit stable et scalable |

| Risques principaux | Bugs, incohérences, dette technique | Dépendance IA, perte de maîtrise |

Les prompts : cœur du pilotage par l’IA

Dans le développement assisté par IA, le prompt est la brique fondamentale. Il ne s’agit pas simplement d’écrire une commande dans une interface : un bon prompt est une spécification, une direction stratégique, parfois même une négociation implicite avec un assistant qui n’a ni mémoire, ni compréhension métier.

Créer, c’est orchestrer plusieurs rôles

Utiliser l’IA pour développer ne revient pas à déléguer l’écriture du code, mais à orchestrer un projet via une succession de prompts alignés avec des rôles métiers bien définis. Dans un flux de développement piloté par IA, un seul humain doit souvent cumuler plusieurs casquettes, chacune nécessitant une posture différente face à l’IA :

- Product Owner / Product Manager : formalise le besoin métier, structure la logique utilisateur, anticipe les fonctionnalités à valeur.

- Chef de projet : gère la cohérence d’ensemble, les dépendances, la feuille de route et la séquence des tâches.

- Lead développeur : choisit l’architecture, définit les patterns à respecter, contrôle la lisibilité du code.

- QA reviewer : identifie les erreurs potentielles, les oublis de couverture de test, les incohérences fonctionnelles.

- CTO : évalue la maintenabilité, la scalabilité, la sécurité et les enjeux long terme du code produit.

Cette multidimensionnalité rend le développement par IA exigeant sur le plan intellectuel, surtout lorsqu’il faut produire des prompts efficaces, structurés, non ambigus… tout en gardant une vision stratégique.

Le prompt comme artefact de conception

Un bon prompt n’est pas une simple requête. C’est un artefact de conception technique et fonctionnelle. Il peut contenir :

- Le contexte métier ou utilisateur,

- Les contraintes techniques à respecter,

- Les objectifs de qualité ou de sécurité,

- La structure attendue de la réponse.

Plus un prompt est précis, mieux il permet de guider l’IA vers un résultat utile. À l’inverse, un prompt flou produit du code inutilisable, voire dangereux.

Une logique de versioning des interactions

Comme le code, les prompts doivent être documentés, versionnés, revus. Ils deviennent un patrimoine du projet à part entière, notamment lorsque plusieurs personnes interagissent avec la même IA sur des morceaux de code liés.

Cette approche demande une rigueur nouvelle, peu compatible avec une logique improvisée. Elle implique aussi des outils, des méthodes et des processus comparables à ceux d’un pipeline DevOps, mais appliqués à la génération assistée.

Les risques liés à l’usage intensif de l’IA

Si l’intelligence artificielle peut accélérer le développement et réduire certains coûts à court terme, son utilisation mal encadrée peut générer de sérieux problèmes à moyen et long terme. Beaucoup d’organisations sous-estiment ces risques, séduites par la facilité apparente qu’offre l’IA générative. Pourtant, les impacts peuvent être structurels.

Perte de compétences internes

L’un des premiers dangers est la désintermédiation des compétences. À force de déléguer les tâches de codage à une IA, les équipes peuvent :

- Perdre leur capacité à lire, corriger ou optimiser du code,

- Oublier les fondements des architectures logicielles,

- Ne plus savoir poser de diagnostics sans l’aide d’un agent intelligent.

Cette perte d’autonomie crée une fragilité opérationnelle, notamment lors de la rotation des effectifs, ou en cas de coupure d’accès à l’outil IA utilisé.

Une dette technique souvent invisible… au départ

L’IA génère du code qui « fonctionne », mais cela ne veut pas dire qu’il est :

- Testé,

- Documenté,

- Optimisé,

- Conforme aux standards internes.

Sans encadrement rigoureux, l’usage de l’IA multiplie les décisions implicites : choix de dépendances inutiles, duplication de logique, contournements hasardeux. Autant de petites décisions qui, cumulées, forment une dette technique difficile à détecter mais coûteuse à corriger.

Dépendance à des outils fermés

La plupart des solutions d’IA disponibles aujourd’hui sont propriétaires, hébergées à l’extérieur de l’entreprise, et souvent dépendantes d’un modèle économique instable.

Cette dépendance peut poser plusieurs problèmes :

- Impossibilité d’auditer les modèles ou les suggestions,

- Hausse soudaine des coûts d’usage,

- Changements d’API ou d’interface sans préavis,

- Risques juridiques liés à la réutilisation de code non maîtrisé.

Problèmes de lisibilité et de maintenabilité

Un code généré par IA est rarement documenté. Il peut aussi être structuré selon des logiques obscures ou des pratiques contraires aux conventions internes. Cela rend le travail de maintenance plus lent et plus risqué, en particulier pour les développeurs qui n’ont pas suivi l’interaction initiale avec l’IA.

Sans un processus de revue humain systématique, on finit par empiler des couches de code incompréhensible, difficile à faire évoluer sans tout réécrire.

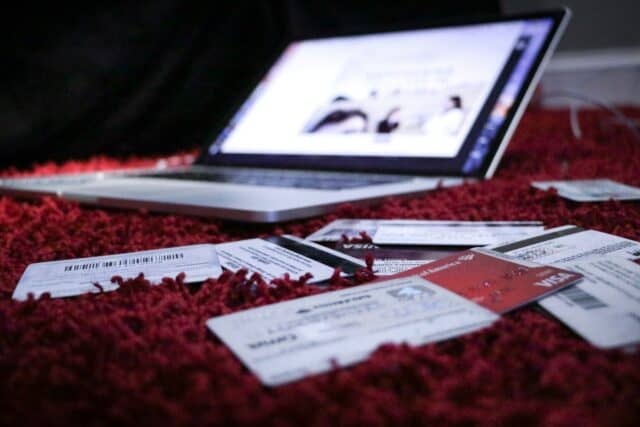

Cybersécurité et IA : un cocktail à manipuler avec précaution

L’usage de l’intelligence artificielle dans le développement soulève de nombreuses préoccupations en matière de cybersécurité, souvent sous-estimées dans l’enthousiasme initial. Pourtant, chaque interaction avec une IA, chaque prompt, chaque code généré, peut introduire des failles, exposer des secrets, ou propager des pratiques à risque.

Fuite de données et de secrets techniques

L’un des risques les plus critiques réside dans la divulgation involontaire d’informations sensibles via les prompts envoyés aux IA hébergées sur des plateformes cloud :

- Clés API, jetons JWT, mots de passe d’administration,

- Configurations d’accès aux bases de données,

- Informations sur l’architecture interne ou les clients,

- Données personnelles ou confidentielles d’utilisateurs.

Même si certains fournisseurs affirment ne pas conserver ces données, la traçabilité et le contrôle réel restent limités. Or, une fois une donnée sensible transmise à une IA externe, il est pratiquement impossible de la supprimer complètement.

Génération de code non conforme aux bonnes pratiques

L’IA produit souvent du code correct d’un point de vue syntaxique, mais non conforme aux normes de sécurité, notamment :

- Manque de validation des entrées utilisateur,

- Stockage non chiffré de données sensibles,

- Utilisation de bibliothèques obsolètes ou vulnérables,

- Mauvaise gestion des erreurs et des exceptions.

Ces failles ne sont pas toujours visibles immédiatement. Elles s’accumulent et peuvent compromettre la sécurité globale du système à terme.

Difficulté à faire respecter les politiques internes

Dans un environnement classique, les règles de sécurité sont implémentées via des politiques internes, des revues de code, et des contrôles qualité. Avec l’IA, le code peut être généré sans respecter ces politiques, sauf si les prompts sont extrêmement bien cadrés — ce qui est rarement le cas dans les projets pressés.

De plus, l’IA peut introduire des dépendances à des services tiers ou des packages sans en informer explicitement l’utilisateur, ce qui complique le suivi de conformité.

Risques liés au partage de code confidentiel

Certains développeurs, pour « aider » l’IA à comprendre le contexte, copient-collent des morceaux entiers de code source dans les interfaces de chat IA. Cela peut inclure :

- Du code propriétaire,

- Des algorithmes stratégiques,

- Des configurations d’infrastructure.

Une fois transmis à un système tiers, ce code devient potentiellement accessible à des modèles entraînés à grande échelle, sans garantie d’exclusivité.

Le futur du rôle de développeur à l’ère de l’IA

L’introduction massive de l’intelligence artificielle dans les processus de développement ne signe pas la fin du métier de développeur. Au contraire, elle en redessine profondément les contours. Les lignes de code ne seront plus l’unique mesure de la valeur apportée. Ce sont la capacité à structurer, piloter, valider et intégrer intelligemment l’IA qui deviendront centrales.

Du codeur à l’orchestrateur

Demain, le développeur ne sera plus simplement un producteur de code. Il deviendra un orchestrateur de solutions, capable de :

- Décomposer un problème en sous-tâches adressables par l’IA,

- Structurer des prompts efficaces et rigoureux,

- Valider et réintégrer les réponses de l’IA dans un tout cohérent,

- Anticiper les effets secondaires d’une logique générée automatiquement.

Il ne s’agit plus seulement de maîtriser un langage ou un framework, mais de maîtriser l’écosystème IA, son comportement, ses limites, ses biais.

Une expertise qui se déplace vers la stratégie et la qualité

Le développeur moderne devra renforcer sa compétence sur des axes jusque-là considérés comme secondaires :

- Architecture logicielle : garantir la robustesse, la maintenabilité.

- Qualité de code et testing : identifier les erreurs générées automatiquement.

- Cybersécurité : veiller à l’intégrité et à la non-régression des systèmes.

- Documentation et traçabilité : assurer une compréhension long terme du projet.

Il ne s’agit pas d’un déclassement, mais d’une évolution vers plus de responsabilités stratégiques.

De nouveaux rôles et spécialités émergent

Avec la généralisation de l’IA, de nouveaux profils hybrides apparaissent :

- Prompt Engineer : spécialisé dans l’écriture de requêtes optimisées.

- AI DevOps : qui intègre les IA dans la chaîne de CI/CD.

- AI Lead Developer : garant de la cohérence et de la qualité du code généré.

- Data Privacy Reviewer : chargé de vérifier que l’IA n’expose pas de données sensibles.

Ces rôles ne remplacent pas les développeurs traditionnels, mais les complètent, dans des équipes plus transverses, plus agiles et plus critiques vis-à-vis de la machine.

Une nécessité de montée en compétences permanente

L’IA évolue rapidement, avec de nouveaux modèles, capacités et interfaces. Le développeur de demain devra adopter une culture d’apprentissage continu, non seulement pour suivre les évolutions techniques, mais aussi pour rester maître de l’outil.

Ignorer cette mutation, c’est risquer de devenir dépendant d’une technologie qu’on ne comprend plus — et donc de perdre son autonomie professionnelle.

L’IA, intelligence sans mémoire

L’un des pièges les plus fréquents dans l’usage de l’intelligence artificielle pour le développement est de surestimer sa capacité de compréhension globale. Aussi impressionnante soit-elle dans ses réponses ponctuelles, l’IA générative ne dispose pas d’une véritable mémoire contextuelle ni d’une conscience du projet dans sa durée.

Une mémoire fragmentée, voire inexistante

Dans la plupart des cas, les outils d’IA n’ont accès qu’à une fenêtre de contexte limitée. Cela signifie :

- Que chaque interaction ne contient qu’un extrait du projet,

- Que l’IA oublie souvent les éléments évoqués précédemment,

- Qu’elle ne suit pas l’évolution des besoins métier au fil du temps.

Résultat : l’IA peut générer des incohérences logiques, réutiliser des noms déjà pris ailleurs, ou oublier des contraintes pourtant définies quelques requêtes plus tôt.

Un travail de reconstruction constant

Pour compenser cette absence de mémoire, le développeur doit en permanence :

- Réintroduire du contexte à chaque prompt (architecture, objectifs, données d’entrée),

- Contrôler manuellement la cohérence entre les différentes réponses,

- Organiser ses prompts et leurs résultats comme on le ferait pour un code source, avec versioning, commentaires, historiques.

Ce processus est fastidieux, mais indispensable pour garder le contrôle. À défaut, on risque de produire un assemblage de fragments sans unité ni lisibilité.

Attention au mirage de la continuité

Certains outils donnent l’illusion qu’ils « se souviennent ». En réalité, cette mémoire est limitée, instable, et non vérifiable. Il est donc dangereux de confier des tâches critiques à une IA en espérant qu’elle « se rappelle » ce qui a été fait dans un précédent prompt.

Ce manque de persistance est particulièrement problématique dans les projets long terme, où les décisions techniques doivent être documentées, suivies et justifiables.

Le rôle irremplaçable du capital humain

Dans un projet numérique, la mémoire du projet, la cohérence métier, la compréhension des enjeux reposent encore sur les humains. L’IA peut assister, mais ne peut pas remplacer la continuité intellectuelle et stratégique qu’apporte une équipe expérimentée.

Cela rappelle une vérité essentielle : l’IA n’est pas intelligente au sens humain. Elle calcule, prédit, génère — mais ne comprend ni le pourquoi, ni le long terme.

Ce qu’il faut retenir

L’IA dans le développement n’est ni une baguette magique, ni une menace systémique. C’est un levier puissant — à condition de savoir l’utiliser avec méthode, lucidité et responsabilité.

- Le développement assisté par IA permet d’accélérer les cycles, de tester des idées rapidement et d’améliorer la productivité. Mais cela demande une structuration rigoureuse.

- Le Vibe Coding, quant à lui, repose souvent sur une méconnaissance des enjeux techniques et produit rarement des résultats viables à long terme.

- Le prompt devient l’unité stratégique centrale : chaque demande faite à l’IA doit être claire, contextuelle, et alignée avec les rôles métier du projet.

- L’usage massif de l’IA implique de nouveaux risques : dette technique, dépendance, perte de compétence, et surtout, problèmes de cybersécurité.

- Le rôle du développeur évolue vers celui d’orchestrateur, garant de la cohérence, de la qualité et de la sécurité du code produit.

- Enfin, rappel essentiel : l’IA ne retient rien. C’est l’humain qui porte la mémoire du projet, le sens des décisions, et la responsabilité du produit livré.

Utiliser l’IA pour développer, oui. Mais jamais sans une vision technique claire, une supervision humaine, et une exigence de qualité constante.

FAQ – IA et développement

Quels sont les 4 types d’IA ?

Les 4 types d’intelligence artificielle, selon leur niveau de sophistication, sont :

IA Réactive : répond à des stimuli sans mémoire (ex. : IA de jeu d’échecs).

IA à mémoire limitée : capable de tirer parti d’un historique court (ex. : assistant vocal).

IA à théorie de l’esprit (encore en développement) : comprend émotions et intentions.

IA auto-consciente (hypothétique à ce jour) : conscience d’elle-même et de son environnement.

La majorité des IA utilisées aujourd’hui dans le développement relèvent du second type.

Qu’est-ce que la programmation assistée par l’IA ?

La programmation assistée par IA consiste à utiliser des outils d’intelligence artificielle pour générer, compléter, corriger ou documenter du code. Ces outils (comme GitHub Copilot ou CodeWhisperer) s’intègrent dans les environnements de développement et permettent de gagner du temps, tout en demandant une relecture humaine pour garantir la qualité et la sécurité du code produit.

C’est quoi un développeur IA ?

Un développeur IA est un professionnel qui conçoit, développe et optimise des systèmes basés sur l’intelligence artificielle. Il peut travailler sur des modèles d’apprentissage automatique (machine learning), des agents conversationnels, des systèmes de recommandation, etc. À ne pas confondre avec un développeur « assisté » par IA, qui utilise l’IA comme outil dans son processus de développement classique.

Qu’est-ce que la révision assistée par l’IA ?

La révision assistée par l’IA désigne l’utilisation d’outils intelligents pour relire automatiquement du code, identifier des erreurs, suggérer des améliorations ou détecter des failles de sécurité. Elle complète les revues humaines, notamment dans les phases de CI/CD, mais ne peut pas remplacer l’expertise d’un développeur expérimenté, surtout sur les questions d’architecture ou de cohérence métier.

Le développement par IA est-il adapté à tous les projets ?

Non. Bien que l’IA puisse accélérer certains types de projets (prototypes, automatisations, front-end simple), elle reste inadaptée à des environnements critiques ou fortement normés sans supervision technique. Les projets demandant une forte cohérence métier, des performances élevées ou un niveau de sécurité important nécessitent une expertise humaine en amont et en aval des interventions de l’IA.